Date de dernière mise à jour :

Sommaire

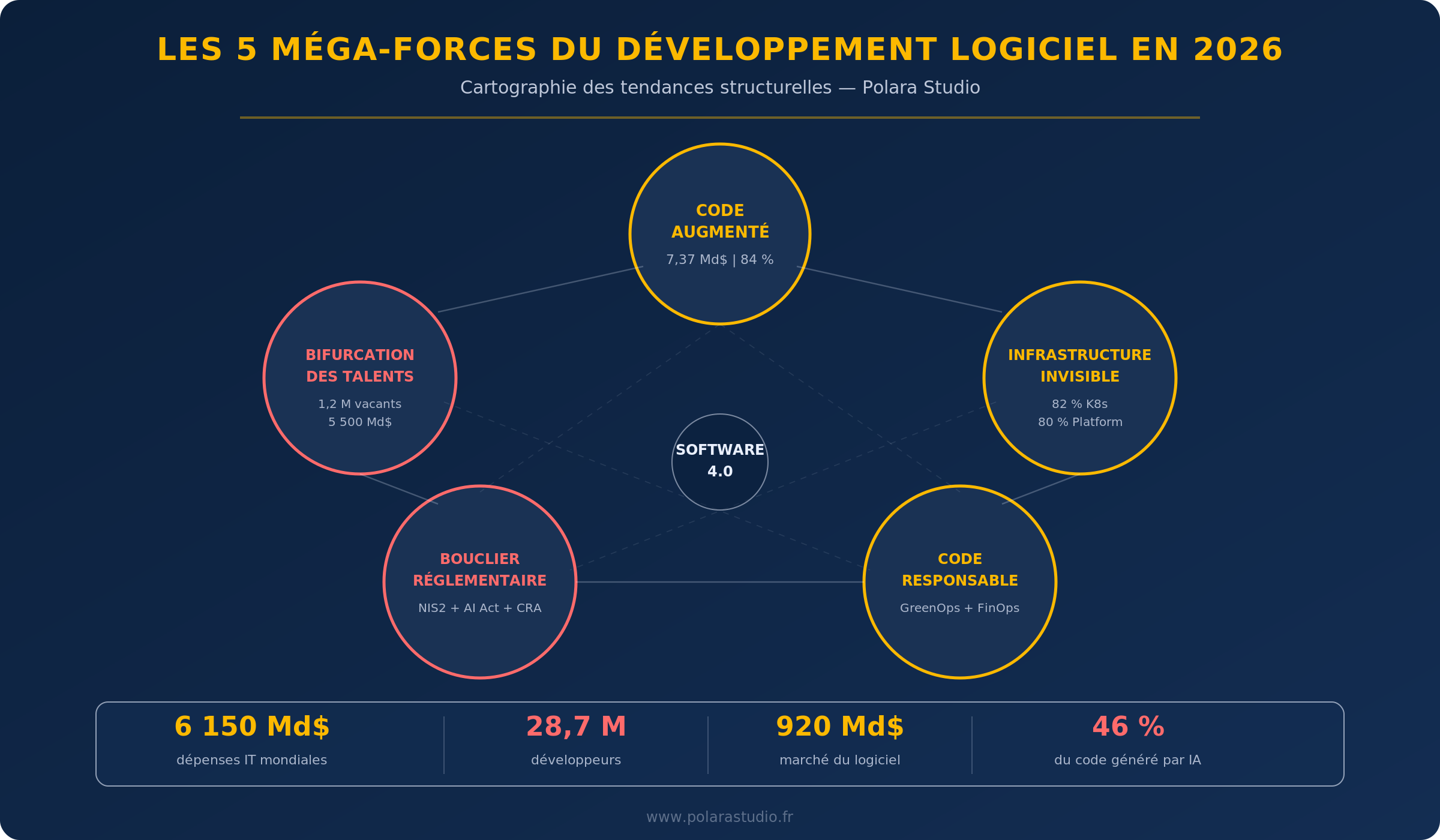

Les tendances et statistiques majeures du développement logiciel en 2026

Près d’une ligne de code commercial sur deux n’est plus écrite par un humain. Elle est suggérée, complétée, parfois entièrement générée par une IA. Et personne — ni les développeurs, ni les DSI, ni les régulateurs — ne sait encore vraiment quoi en faire.

C’est ça, le vrai sujet de 2026. Pas la « transformation digitale », pas le cloud, pas même la blockchain. C’est le moment où le métier de développeur, vieux de soixante ans, vient de basculer dans quelque chose de neuf — sans manuel d’instructions. Les uns y voient une libération. Les autres, une perte de contrôle. Et entre les deux, des entreprises qui découvrent qu’aller plus vite ne veut pas dire aller mieux.

Cette mutation n’arrive pas seule. Elle se télescope avec une vague réglementaire européenne sans précédent, une pénurie de talents qui s’aggrave malgré l’automatisation, et la prise de conscience que chaque ligne de code a désormais un coût carbone. Chez Polara Studio, on vit ces tensions en direct sur nos projets de logiciels sur mesure et de SaaS. Et plutôt que d’en faire une énième liste de tendances, on a voulu raconter ce qui se passe vraiment : cinq méga-forces qui redessinent l’industrie en silence, avec les chiffres pour le prouver. Bienvenue dans le Software 4.0.

1. Le « Code Augmenté » : l’IA comme co-développeur

Si 2023 était l’année de la découverte et 2024 celle de l’expérimentation, 2026 est définitivement l’année de l’industrialisation de l’IA dans le développement logiciel. Le développeur ne code plus seul — il pilote un binôme humain-machine dont les contours se redéfinissent chaque trimestre.

L’explosion des assistants IA : un marché à 7,37 milliards de dollars

Les chiffres parlent d’eux-mêmes. Selon le Stack Overflow Developer Survey 2025, 84 % des développeurs utilisent ou prévoient d’utiliser des outils d’IA dans leur processus de développement, et 47 % les utilisent quotidiennement. GitHub Copilot, le leader du marché avec 42 % de parts de marché, revendique désormais 20 millions d’utilisateurs cumulés et 1,3 million d’abonnés payants. Le taux d’adoption atteint 90 % dans les entreprises du Fortune 100.

Les gains de productivité mesurés sont significatifs : une étude GitHub portant sur 4 800 développeurs montre que les tâches sont complétées 55 % plus rapidement avec Copilot. Le temps moyen d’une pull request est passé de 9,6 jours à 2,4 jours. Et le marché global des assistants de code IA a atteint 7,37 milliards de dollars en 2025.

Mais le vrai basculement, c’est le volume : GitHub Copilot génère désormais 46 % du code écrit par les développeurs qui l’utilisent (avec des pics à 61 % en Java). On n’est plus dans le gadget — on est dans un changement fondamental de la façon dont le code est produit.

Le vibe coding — coder par intention plutôt que par instruction

Le paradigme de programmation vit un tournant inattendu. Le vibe coding — terme popularisé par Andrej Karpathy début 2025 — désigne le fait de coder en décrivant une intention en langage naturel plutôt qu’en écrivant des instructions ligne par ligne. Le MIT l’a classé parmi ses 10 Breakthrough Technologies 2026.

Le marché du vibe coding est estimé à 4,7 milliards de dollars, porté par des outils comme Cursor, Bolt, Lovable ou Replit Agent. Et le phénomène dépasse largement la communauté des développeurs : une majorité des utilisateurs de ces plateformes ne sont pas développeurs. Des product managers, des designers, des entrepreneurs créent des prototypes fonctionnels en quelques heures.

Côté géants de la tech, Google et Microsoft annoncent que plus de 30 % de leur nouveau code est désormais généré par IA. Gartner prédit que 60 % du code sera AI-generated d’ici fin 2026. Pour en savoir plus sur cette tendance, il y a cet article sur le vibe coding qu’on a publié récemment.

L’ère agentique — des assistants aux équipes autonomes d’IA

2026 marque l’avènement de ce qu’on appelle l’IA agentique — des systèmes d’IA capables d’exécuter des tâches complexes de manière autonome, en enchaînant des actions, en prenant des décisions intermédiaires et en interagissant avec des outils externes. On passe du simple « copilote » à de véritables équipes virtuelles.

Le marché est en pleine explosion : 11,55 milliards de dollars en 2026, avec une trajectoire vers 236 milliards en 2034 (CAGR de 45,8 % selon Precedence Research). Côté adoption, 51 % des organisations interrogées par LangChain déclarent avoir des systèmes multi-agents en production, et 78 % planifient un déploiement imminent.

| Indicateur | Valeur | Source |

|---|---|---|

| Marché mondial IA agentique | 11,55 Md$ (2026) → 236 Md$ (2034) | Precedence Research |

| Agents en production | 51 % des organisations | LangChain (1 300 pros) |

| Gain de rapidité développeurs | +126 % | Études agrégées |

| ROI moyen (top performers) | Jusqu’à 18 % | IBM |

| Apps avec capacités agentiques d’ici 2028 | 33 % des apps enterprise | Gartner |

| Entreprises non-tech utilisant l’agentique | 90 % (utilisent ou planifient) | EY |

Les cas d’usage les plus matures : la recherche et la synthèse d’information (58 %), l’automatisation de workflows (53,5 %), le service client (45,8 %) et la génération de code (35,5 %). Chez Polara Studio, notre pôle IA accompagne déjà plusieurs clients sur l’intégration d’agents intelligents dans leurs logiciels métier.

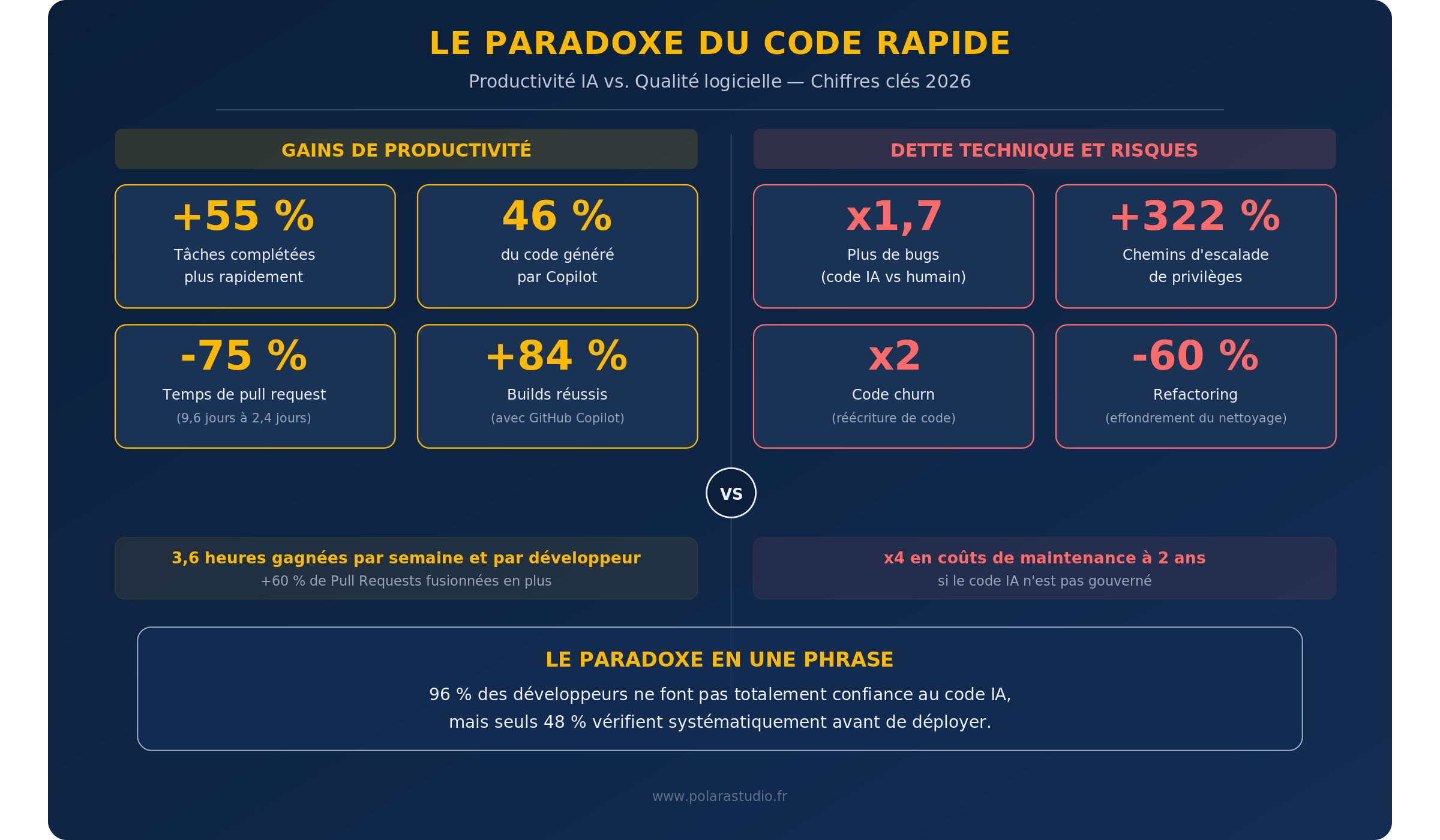

Le « Paradoxe du Code Rapide » — productivité vs. qualité

Mais derrière l’enthousiasme, un paradoxe émerge. C’est ce que nous appelons le Paradoxe du Code Rapide : plus on code vite grâce à l’IA, plus on accumule de la dette technique et de vulnérabilités.

Les données sont sans appel :

| Métrique | Impact mesuré |

|---|---|

| Bugs et issues totaux | 1,7× plus élevés dans le code IA vs. code humain |

| Erreurs de logique | 1,75× plus fréquentes |

| Erreurs de maintenabilité | 1,64× plus élevées |

| Chemins d’escalade de privilèges | +322 % dans le code IA |

| Code churn (réécriture) | ×2 avec l’assistance IA |

| Code copié-collé | +48 % |

| Refactoring | Effondré de 25 % à moins de 10 % |

| Coûts de maintenance à 2 ans | ×4 si code IA non gouverné |

Le sentiment positif envers les outils d’IA a d’ailleurs chuté à 60 % en 2025 (contre plus de 70 % les années précédentes), et 96 % des développeurs admettent ne pas faire totalement confiance à l’exactitude du code généré, selon une enquête Sonar menée auprès de 1 100 développeurs. Pire : seuls 48 % déclarent vérifier systématiquement le code IA avant de le pousser en production. On assiste à l’émergence de ce que les analystes appellent la « dette de vérification » (verification debt) — une dette qui s’ajoute à la dette technique classique et qui provient du fossé entre la vitesse de génération et la capacité humaine de relecture.

Le travail de vérification se déplace vers les ingénieurs seniors — ce qui accentue encore la pression sur les profils les plus expérimentés. L’ironie : des études empiriques montrent que certains développeurs très expérimentés mettent jusqu’à 19 % plus de temps à accomplir des tâches complexes sur leurs propres bases de code quand ils utilisent l’IA, en raison du temps requis pour comprendre et corriger un code « presque juste ». Les tâches laborieuses (toil) n’ont pas été éradiquées — elles se sont simplement déplacées de la phase de conception vers la phase de relecture, de débogage et de correction, consommant encore environ 24 % de la semaine d’un développeur.

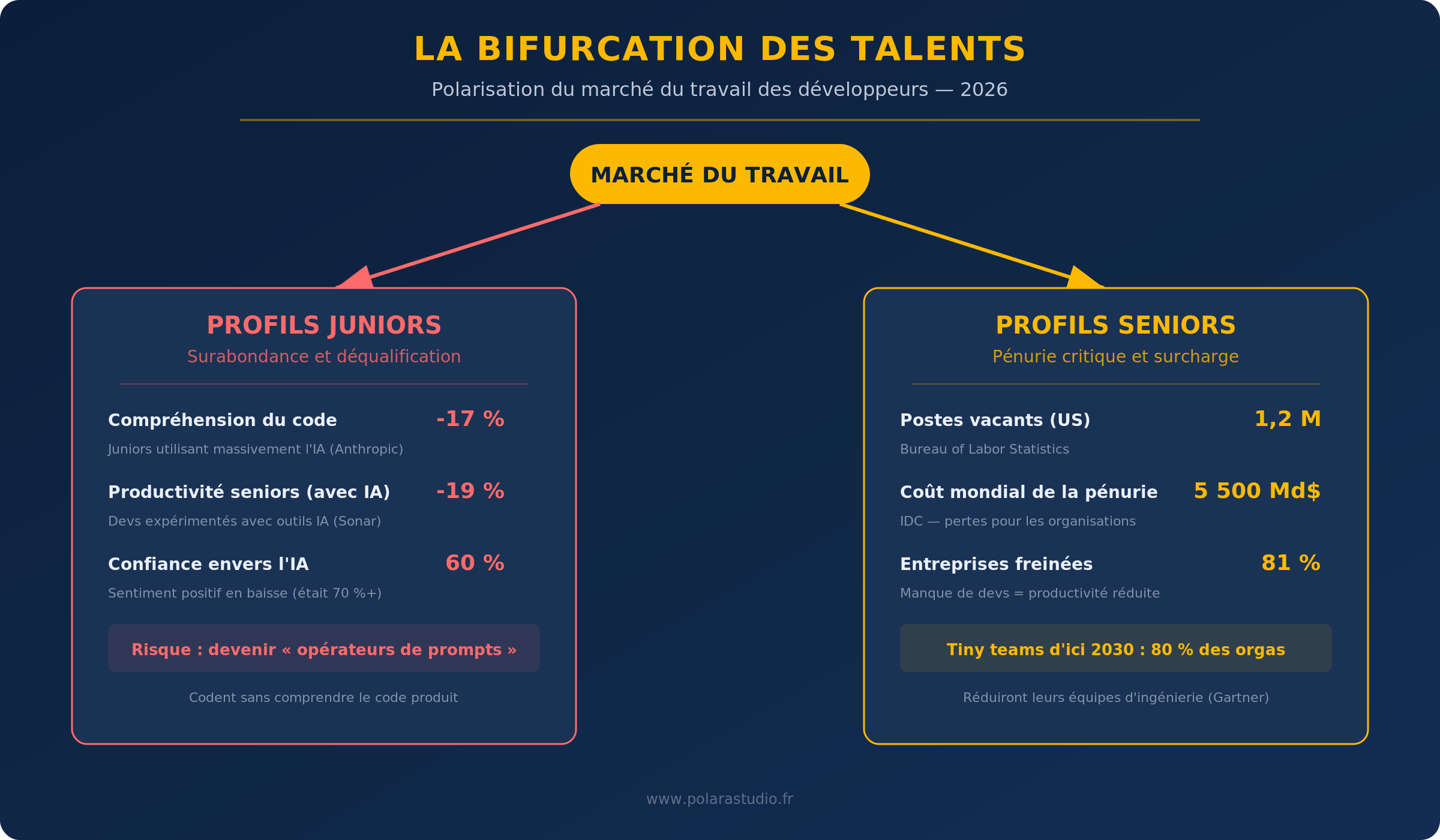

2. La « Bifurcation des Talents » : un marché du travail polarisé

Le marché du travail dans le développement logiciel ne souffre pas d’une simple pénurie. Il vit une polarisation structurelle inédite : d’un côté, une surabondance de profils juniors dont les compétences sont érodées par l’IA ; de l’autre, une raréfaction critique des seniors capables de piloter des systèmes complexes en production.

La pénurie structurelle : 5 500 milliards de dollars de pertes

Les chiffres globaux donnent le vertige. Le Bureau of Labor Statistics américain estime que la pénurie de développeurs aux États-Unis dépassera 1,2 million de postes vacants en 2026. À l’échelle mondiale, on parle de 4 millions de postes non pourvus.

L’IDC chiffre l’impact économique à 5 500 milliards de dollars de pertes pour les organisations d’ici 2026. Et une large majorité des entreprises déclarent que le manque de développeurs freine directement leur productivité. Selon ManpowerGroup (39 000 employeurs interrogés dans 41 pays), l’expertise en IA est devenue la compétence la plus difficile à trouver sur le marché mondial — dépassant pour la première fois les compétences traditionnelles en ingénierie informatique. 72 % des employeurs admettent rencontrer de grandes difficultés à pourvoir leurs postes tech.

En France, le tableau est singulier. Le secteur du numérique emploie plus de 666 000 personnes pour un chiffre d’affaires dépassant 70 milliards d’euros (Numeum), en hausse de 4,3 % après une année 2025 difficile. Le taux de chômage des ingénieurs IT reste inférieur à 3 % — quasi plein emploi. Mais l’IA bouleverse les modèles économiques : les gains de productivité (estimés à 17 % en 2026 pour les ESN) poussent les clients à exiger des baisses de TJM ou une facturation au forfait indexée sur la valeur livrée. Résultat : la part de l’offshore dans le CA des ESN est passée de 15,5 % à 18 % en un an, et les investissements en souveraineté numérique représentent des enveloppes de 150 000 à 200 000 € par entreprise. L’Indice de Résilience Numérique (IRN), lancé par Bercy en janvier 2026, dote désormais les COMEX d’un langage standardisé pour évaluer leurs dépendances technologiques.

Le deskilling silencieux — quand l’IA déqualifie les juniors

Voici le phénomène le plus préoccupant et le moins médiatisé de 2026 : le deskilling (déqualification) des développeurs juniors. Une étude interne d’Anthropic révèle que les juniors utilisant massivement des assistants IA montrent une baisse de 17 % de leur compréhension du code qu’ils produisent. Ils deviennent des « opérateurs de prompts » plutôt que des ingénieurs.

Le résultat ? Une bifurcation du marché du travail : plus de candidats juniors que jamais en compétition pour moins de postes d’entrée, et une pénurie qui s’aggrave sur les profils seniors capables d’opérer l’IA en production, de maîtriser des architectures complexes et de livrer sous pression.

C’est cette dynamique qui pousse Gartner à prédire que 80 % des organisations auront réduit la taille de leurs équipes d’ingénierie d’ici 2030, au profit de « tiny teams » — des équipes restreintes (parfois 2-3 personnes) augmentées par l’IA, capables de produire autant qu’une équipe de 10 il y a cinq ans.

Low-code / No-code — la démocratisation à 44,5 milliards de dollars

En parallèle, le low-code et le no-code poursuivent leur ascension fulgurante. Gartner estime le marché à 44,5 milliards de dollars en 2026, avec une projection selon laquelle 75 % des nouvelles applications seront construites sur ces plateformes. 4 entreprises sur 5 considèrent le low-code comme stratégiquement important.

Ce mouvement crée une nouvelle catégorie de créateurs : les citizen developers — des collaborateurs non techniques qui construisent des applications métiers. Pour autant, le développement sur mesure conserve toute sa pertinence pour les projets à forte valeur ajoutée. Faut-il développer un logiciel sur mesure ? reste une question cruciale que nous abordons en détail.

Le nearshoring comme levier stratégique

Face à cette pénurie, les entreprises se tournent massivement vers l’externalisation. Le marché mondial de l’outsourcing logiciel atteint 618 milliards de dollars en 2026 (Mordor Intelligence), avec une tendance forte vers le nearshoring : 58 % des entreprises IT préfèrent désormais des partenaires en zone horaire proche.

| Indicateur | Valeur |

|---|---|

| Marché mondial outsourcing logiciel | 618,38 Md$ (2026) → 977 Md$ (2031) |

| Part du nearshore | 64 % des services externalisés |

| Préférence nearshore | 58 % des entreprises IT |

| Économies moyennes | 40 à 46 % vs. onshore |

| Déploiement plus rapide | +50 % |

| CAGR nearshore (2026-2031) | 13,95 % |

L’outsourcing n’est plus seulement une question de coûts (même si 70 % des entreprises le citent comme motivation première) — c’est devenu un levier pour accéder à des compétences rares en IA, cybersécurité et cloud-native. Pour les entreprises françaises, bien choisir son prestataire de développement devient un avantage compétitif majeur.

L’Expérience Développeur (DevEx) — le nouveau champ de bataille RH

La rétention des talents passe par un concept qui s’impose comme impératif stratégique en 2026 : la Developer Experience (DevEx). Une étude menée auprès de 40 000 développeurs dans 800 organisations a démontré que les équipes évoluant dans un environnement offrant une excellente DevEx sont 4 à 5 fois plus performantes en vitesse de livraison, qualité du code et rétention des talents.

L’industrie adopte massivement le framework SPACE (inspiré par Microsoft Research), qui mesure trois dimensions : les boucles de rétroaction (vitesse des tests, clarté des logs CI/CD), la charge cognitive (complexité perçue de la codebase, temps de code review) et l’état de flux (capacité à se concentrer sans interruption). Car un environnement de développement inadapté coûte cher : selon Stripe, les ingénieurs sacrifient en moyenne 17 heures par semaine (près de la moitié de leur temps) à la maintenance, aux bugs d’outillage et au remboursement de dette technique — du temps qui ne peut être alloué à l’innovation.

Côté recrutement, un paradoxe inattendu : la généralisation des assistants IA a provoqué une inflation massive des candidatures automatisées, noyant les recruteurs sous un « bruit » de soumissions générées. Résultat : 60 % des responsables de Talent Acquisition ont fait de la « qualité de l’embauche » leur priorité n°1. Les entretiens algorithmiques classiques cèdent la place à des mises en situation réelles où l’on évalue l’« AI Fluency » du candidat — sa capacité à utiliser les assistants de manière critique, à repérer les hallucinations dans du code multi-fichiers, et à justifier ses choix d’architecture face à la machine.

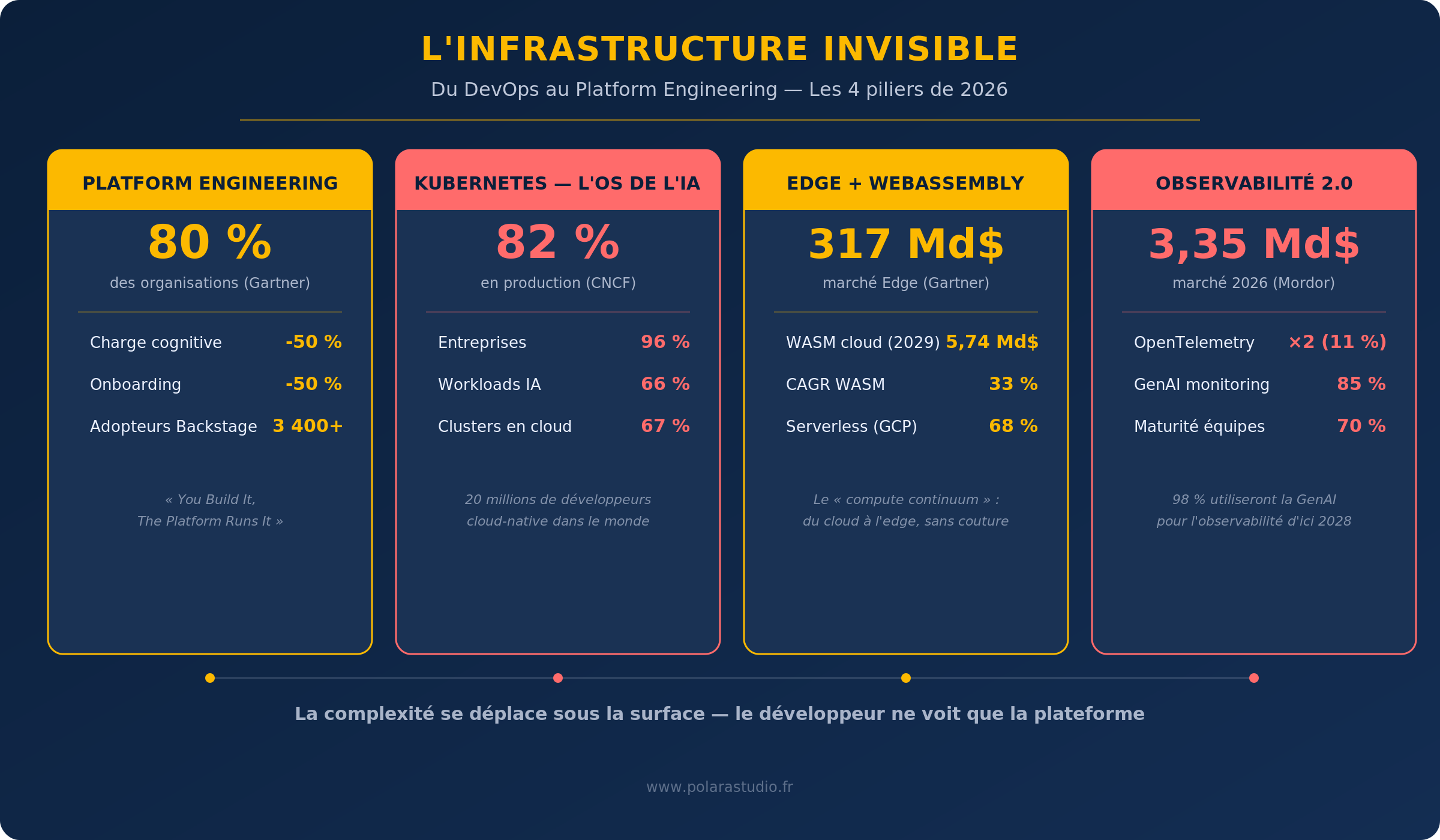

3. L’« Infrastructure Invisible » : la plateforme mange le DevOps

La troisième méga-force de 2026 est peut-être la plus silencieuse — mais aussi la plus transformatrice. L’infrastructure logicielle est en train de devenir invisible. On passe du paradigme « You Build It, You Run It » (le développeur gère tout) au « You Build It, The Platform Runs It » — la plateforme absorbe la complexité opérationnelle.

Platform Engineering — 80 % des organisations en 2026

Le Platform Engineering est la tendance infra la plus structurante de l’année. Gartner estime que 80 % des grandes organisations auront adopté une forme de plateforme d’ingénierie interne d’ici 2026 — un bond considérable par rapport aux 45 % de 2022.

Le principe : construire une « developer platform » interne qui expose des abstractions simples (déployer une app, créer une base de données, configurer un pipeline CI/CD) tout en masquant la complexité sous-jacente (Kubernetes, réseaux, sécurité, observabilité). Les résultats mesurés : -40 à 50 % de charge cognitive pour les développeurs et -50 % de temps d’onboarding pour les nouveaux arrivants.

L’outil emblématique de ce mouvement est Backstage (créé par Spotify, désormais projet CNCF), adopté par plus de 3 400 organisations. Et le Platform Engineering embarque désormais nativement des garde-fous de sécurité (« Compliance-as-a-Service »), garantissant que les environnements déployés respectent les politiques de l’entreprise sans intervention manuelle. Le marché de l’Infrastructure-as-Code (IaC), socle technologique de ces plateformes, est en voie de passer de 908 millions de dollars en 2023 à plus de 3,3 milliards en 2030.

Cette automatisation évolue vers l’AIOps (IA pour les opérations IT). D’ici 2026, Gartner prédit que plus de 60 % des grandes entreprises adopteront des systèmes d’auto-réparation (self-healing systems) pilotés par l’AIOps. Ces plateformes ingèrent des téraoctets de données d’observabilité en temps réel pour prédire les défaillances avant qu’elles n’impactent les utilisateurs, appliquer des politiques de scaling dynamiques et orchestrer des rollbacks intelligents. Néanmoins, un décalage subsiste : seules 4 % des organisations déclarent avoir atteint une maturité totale en production, signalant d’immenses opportunités pour les années à venir.

Kubernetes — le « système d’exploitation de l’IA »

La CNCF Annual Survey 2025 consacre Kubernetes comme l’infrastructure dominante : 82 % des utilisateurs de conteneurs l’exécutent en production, et 96 % des entreprises l’utilisent sous une forme ou une autre. Deux tiers des clusters sont désormais hébergés dans le cloud (contre 45 % en 2022).

Le fait marquant de 2026 : 66 % des organisations hébergeant des modèles d’IA générative utilisent Kubernetes pour gérer tout ou partie de leurs workloads d’inférence. K8s n’est plus seulement un orchestrateur de conteneurs — c’est devenu le système d’exploitation de facto de l’IA en entreprise.

Le nombre de développeurs cloud-native approche les 20 millions, et 59 % des organisations déclarent que « la majorité ou la quasi-totalité » de leur développement est désormais cloud-native. Le multicloud est devenu la norme : 90 % des entreprises utilisent une stratégie multicloud pour réduire le vendor lock-in, optimiser les coûts et améliorer la tolérance aux pannes. AWS conserve ~33 % de parts de marché, mais la standardisation autour de Kubernetes rend la portabilité inter-cloud bien plus accessible qu’il y a trois ans.

La révolution des bases de données vectorielles

La transformation la plus disruptive côté data en 2026 est la prolifération des bases de données vectorielles. Conséquence directe de l’explosion de l’IA générative et des architectures RAG (Retrieval-Augmented Generation), les LLM nécessitent des bases capables de stocker, indexer et interroger des millions d’embeddings vectoriels avec une latence de l’ordre de la milliseconde.

Des acteurs spécialisés comme Pinecone, Qdrant ou LanceDB (écrit en Rust, format Apache Arrow) dominent ce nouveau segment. Pour contrer la fragmentation, les bases historiques ont réagi en intégrant nativement la recherche vectorielle — comme MongoDB Atlas Vector Search ou l’extension pgvector pour PostgreSQL, devenu le choix open source de référence pour tout nouveau projet relationnel.

WebAssembly et Edge Computing — le runtime universel

En parallèle, deux technologies convergent pour redéfinir où et comment le code s’exécute. Le Edge Computing représente un marché de 317 milliards de dollars selon Gartner, porté par l’IoT, le 5G et le besoin de latence ultra-faible. Le WebAssembly (WASM), initialement conçu pour le navigateur, devient un runtime universel côté serveur et edge, avec un marché cloud projeté à 5,74 milliards de dollars d’ici 2029 (CAGR de 33 % selon Markets and Markets).

La combinaison des deux crée ce que certains architectes appellent le « compute continuum » — un continuum de calcul du cloud à l’edge, avec WASM comme format d’exécution portable et sécurisé.

Observabilité 2.0 — l’intelligence dans le monitoring

L’observabilité — la capacité à comprendre l’état interne d’un système à partir de ses sorties — entre dans une nouvelle ère. Le marché atteint 3,35 milliards de dollars en 2026 (Mordor Intelligence), en croissance de 15,6 % par an.

Deux tendances dominent. D’abord, OpenTelemetry : le standard open source d’instrumentation a doublé son adoption en production (de 6 % à 11 %), avec 57 % d’utilisation pour les métriques, 50 % pour les traces et 48 % pour les logs. Ensuite, l’IA appliquée à l’observabilité : 85 % des organisations utilisent la GenAI pour leurs outils de monitoring (selon Elastic), et ce chiffre devrait atteindre 98 % d’ici deux ans.

La maturité des équipes d’observabilité a bondi à 70 % (contre 45 % en 2025), signe que les organisations prennent enfin au sérieux la visibilité sur leurs systèmes distribués.

4. Le « Bouclier Réglementaire » : la compliance comme avantage compétitif

2026 est l’année où l’Europe passe de la théorie réglementaire à la pratique. Trois textes majeurs entrent en application simultanément, créant ce que nous appelons le Bouclier Réglementaire européen — un cadre contraignant qui, bien maîtrisé, devient un véritable avantage compétitif.

Le triptyque NIS2 / AI Act / CRA — l’Europe légifère en force

Trois régulations convergent en 2026 :

| Régulation | Entrée en application | Cible principale | Sanctions max. |

|---|---|---|---|

| NIS2 (Network & Information Security) | Octobre 2024 (transposition en cours) | Infrastructures critiques, supply chain IT | 10 M€ ou 2 % du CA |

| AI Act | Août 2026 (pleine application) | Systèmes IA à haut risque, développeurs et déployeurs | 35 M€ ou 7 % du CA |

| CRA (Cyber Resilience Act) | Septembre 2026 (reporting obligatoire) | Tout produit avec un élément numérique | 15 M€ ou 2,5 % du CA |

Le point critique : un même incident — une faille de sécurité dans un SaaS qui utilise de l’IA et qui traite des données de santé, par exemple — peut déclencher des obligations de reporting simultanées sous trois régimes différents, chacun avec ses propres délais, tests de matérialité et régulateurs. Le CRA est particulièrement impactant : bien que la conformité totale ne soit exigée que pour décembre 2027, l’obligation de signaler toute vulnérabilité activement exploitée entre en vigueur dès le 11 septembre 2026. Les coûts de développement intègrent désormais ces contraintes de conformité comme un poste à part entière.

La supply chain logicielle sous attaque

Les attaques sur la chaîne d’approvisionnement logicielle ont explosé. Selon Sonatype, le nombre de packages malveillants détectés a bondi de +75 %, atteignant 454 648 rien qu’en 2024 (portant l’inventaire cumulé à plus de 1,2 million), sur un écosystème de 9,8 trillions de téléchargements. Le coût estimé des attaques supply chain a atteint entre 53 et 81 milliards de dollars en 2025.

Le danger est amplifié par ce que les DSI appellent l’« effet domino » (Ripple Effect) : 98 % des vulnérabilités critiques open source se cachent dans des dépendances transitives — le code importé par d’autres bibliothèques tierces. Un composant mineur compromis peut ouvrir une brèche critique au cœur d’un système bancaire ou hospitalier.

Face à cette menace, le SBOM (Software Bill of Materials) — un inventaire exhaustif de tous les composants d’un logiciel — devient obligatoire dans plusieurs juridictions. Le CRA européen exige que tout produit numérique vendu dans l’UE soit accompagné d’un SBOM complet. Des outils comme Anchore, Syft, Trivy ou NXRadar s’intègrent nativement dans les pipelines CI/CD pour cataloguer l’origine, la licence et la version de chaque dépendance. L’innovation 2026 : le couplage dynamique de ces inventaires avec des bases de Threat Intelligence alimentées par IA, alertant en temps réel sur les vulnérabilités Zero-Day.

DevSecOps 2.0 — la sécurité « Shift Everywhere »

Le marché du DevSecOps atteint 10,88 milliards de dollars en 2026, porté par l’intégration de l’IA dans les outils de sécurité : 75 % des organisations utilisent désormais l’IA/ML pour la revue de code sécuritaire. Le coût moyen d’une brèche de données s’établit à 4,44 millions de dollars selon le rapport 2025 d’IBM.

On ne parle plus seulement de « Shift Left » (intégrer la sécurité plus tôt dans le cycle de développement) mais de « Shift Everywhere » : la sécurité est présente à chaque étape — de la conception à la production, en passant par la chaîne d’approvisionnement, l’infrastructure et le runtime. Le modèle Zero Trust (ne faire confiance à aucune entité par défaut) est désormais considéré comme incontournable par la quasi-totalité des professionnels de la cybersécurité. Mais son déploiement opérationnel complet reste un défi : seule une minorité d’organisations l’a finalisé, en raison de la complexité des systèmes hérités. Le coût global de la cybercriminalité a franchi la barre stupéfiante des 10 000 milliards de dollars en 2025 — un chiffre qui rend ces investissements en sécurité non optionnels.

La souveraineté numérique — le cloud européen en plein essor

Le marché du cloud souverain européen connaît une croissance spectaculaire : +83 % en un an, passant de 6,9 milliards de dollars en 2025 à 12,6 milliards en 2026 (selon The Register). Le marché mondial du cloud souverain est projeté à 80 milliards de dollars en 2026.

Le contexte : trois hyperscalers américains détiennent encore 70 % du marché cloud européen, mais 60 % des CIOs et responsables IT d’Europe de l’Ouest souhaitent augmenter leur recours à des fournisseurs locaux. Le RGPD, l’AI Act et le European Data Act obligent de plus en plus d’organisations à stocker et traiter leurs données sur le sol européen — un mouvement que des initiatives comme GAIA-X cherchent à structurer.

Pour les éditeurs de SaaS, la question de la souveraineté des données n’est plus optionnelle. Comme on l’explique dans notre article sur le marché SaaS en 2026, c’est devenu un critère d’achat à part entière pour les clients européens.

5. Le « Code Responsable » : performance, durabilité et maîtrise des coûts

La dernière méga-force est peut-être la plus inattendue dans un secteur souvent perçu comme « immatériel ». En 2026, le logiciel est jugé non seulement sur ce qu’il fait, mais sur ce qu’il coûte (en argent et en carbone). Le Code Responsable, c’est la convergence de trois impératifs : la performance technique, la durabilité environnementale et la maîtrise financière.

GreenOps — le logiciel face à son empreinte carbone

Le secteur du numérique représente entre 2 et 3 % des émissions mondiales de gaz à effet de serre — autant que l’aviation civile — et cette part croît à mesure que les datacenters se multiplient pour alimenter les modèles d’IA. Selon Gartner, 50 % des organisations intègrent désormais le monitoring de durabilité dans leurs opérations cloud.

Le GreenOps — l’application des principes de développement durable aux opérations logicielles — se structure autour d’une métrique clé : le Software Carbon Intensity (SCI). Contrairement aux rapports d’émissions globaux, le SCI quantifie les émissions générées spécifiquement par l’exécution d’une application, rapportées à une unité fonctionnelle (grammes de CO2 par utilisateur actif, par transaction, ou par appel API). Les équipes d’ingénierie intègrent désormais cette métrique directement dans leurs pipelines CI/CD : lors d’une pull request, des outils comme le Green Metrics Tool estiment l’impact carbone de la modification avant son déploiement.

En France, le cadre est structuré par le RGESN (Référentiel Général de l’Écoconception des Services Numériques), coréalisé par l’Arcep, l’ADEME et la DINUM. Mis à jour en 2026 pour couvrir les projets data et IA, il impose une méthodologie stricte dès la phase de conception : limiter l’obsolescence des terminaux, optimiser les requêtes réseau, et publier une « déclaration d’écoconception ». Les résultats sont tangibles : les entreprises les plus avancées rapportent une réduction de 20 % de leur empreinte cloud grâce à l’optimisation de l’infrastructure et du code.

FinOps — la fin du gaspillage cloud

Le GreenOps a un allié naturel : le FinOps — la discipline de gestion financière du cloud. Car la réalité est brutale : entre 25 et 35 % des dépenses cloud sont gaspillées (ressources sur-provisionnées, instances oubliées, architectures inefficaces). Le marché du FinOps est estimé à 23,3 milliards de dollars d’ici 2029, avec une adoption en hausse de 46 % en 2025.

L’ère de l’IA accentue le problème : entraîner un LLM coûte plusieurs millions de dollars, et les coûts d’inférence en production peuvent rapidement déraper. La preuve de l’importance croissante de cette discipline : 98 % des équipes FinOps ont désormais la responsabilité de suivre et d’optimiser les coûts liés à l’IA (contre seulement 63 % un an plus tôt). Et ces équipes ne sont plus cantonnées à un rôle comptable : 78 % rapportent directement au CTO ou au CIO plutôt qu’à la direction financière. La frontière entre FinOps et GreenOps a totalement disparu — optimiser la facture cloud revient mécaniquement à réduire l’empreinte carbone.

Rust, TypeScript, Go — les langages de la performance durable

Les choix de langages de programmation reflètent cette quête de performance et de durabilité. Trois langages incarnent particulièrement cette tendance en 2026 :

| Langage | Adoption / Tendance | Force principale |

|---|---|---|

| TypeScript | #1 sur GitHub (2,6 M de contributeurs) | Typage statique, écosystème web dominant |

| Rust | +45 % d’adoption en entreprise | Sécurité mémoire, performance native, 0 runtime overhead |

| Go | 4,1 M de développeurs pros | Simplicité, concurrence native, écosystème cloud-native |

Rust mérite une attention particulière : adopté par le noyau Linux, Microsoft, Google et Amazon pour les composants critiques, il élimine par conception les bugs de mémoire qui représentent 70 % des vulnérabilités de sécurité dans les logiciels systèmes. Dans un monde où la sécurité et la performance énergétique deviennent des critères de conformité, Rust n’est plus un choix technique — c’est un choix stratégique. Pour savoir quelles technologies choisir pour un projet, nous avons publié un guide complet sur les technologies pour son SaaS en 2026.

La modernisation du legacy — l’IA comme antidote à la dette historique

Un angle souvent oublié du Code Responsable : la modernisation des systèmes hérités (legacy). En 2026, la dette technique accumulée dans les applications patrimoniales coûte aux entreprises américaines plus de 2 400 milliards de dollars par an. Les organisations lourdement endettées dépensent 40 % de budget supplémentaire en maintenance et déploient de nouvelles fonctionnalités 25 à 50 % plus lentement.

L’ironie : c’est l’IA elle-même qui fournit l’antidote. Plus de 80 % des grandes entreprises s’appuient sur des outils assistés par IA pour auditer et moderniser leurs systèmes patrimoniaux. Des frameworks multi-agents scannent des millions de lignes de code, cartographient les dépendances, résument la logique métier enfouie et proposent des scénarios de refactorisation vers des architectures cloud-natives. Les résultats sont spectaculaires : la migration de code Java complexe vers C#.NET assistée par IA peut comprimer la durée de mise à niveau de près de 50 % selon les retours d’expérience des early adopters. Sur des mainframes COBOL, les outils IA atteignent des niveaux de précision élevés dans l’extraction de documentation comportementale — résolvant un goulot d’étranglement historique où les développeurs passaient entre 52 et 70 % de leur temps à simplement comprendre le code existant. Pour les entreprises dans cette situation, notre guide sur la reprise de projet logiciel détaille la démarche.

La dette technique amplifiée par l’IA

On boucle la boucle avec le Paradoxe du Code Rapide évoqué en première partie. 75 % des décideurs technologiques font face à une dette technique modérée à sévère issue des pratiques de développement accélérées par l’IA. L’analyse de plus de 211 millions de lignes de code modifiées entre 2020 et 2024 montre un effondrement de 60 % du code refactoré — signe que les équipes ajoutent du code sans jamais nettoyer.

Le résultat : des bases de code qui grossissent plus vite qu’elles ne se rationalisent, des coûts de maintenance qui explosent, et une complexité accidentelle qui ralentit l’innovation. La dette technique n’est pas un problème nouveau, mais l’IA l’a transformée en bombe à retardement.

Conclusion — Les 5 méga-forces qui redessinent le paysage

Si l’on devait résumer 2026 en une phrase, ce serait : le développement logiciel est entré dans l’ère de la complexité maîtrisée. Chaque méga-force que nous avons identifiée porte en elle un paradoxe :

Le Code Augmenté accélère la production mais fragilise la qualité. La Bifurcation des Talents démocratise la création logicielle tout en creusant le fossé entre opérateurs et architectes. L’Infrastructure Invisible simplifie l’expérience développeur au prix d’une complexité sous-jacente accrue. Le Bouclier Réglementaire protège les utilisateurs mais impose un coût de conformité significatif. Le Code Responsable rend le logiciel plus durable mais exige une discipline nouvelle.

Pour les entreprises, le message est clair : la capacité à naviguer ces tensions — pas à les résoudre, mais à les gérer — sera le principal facteur de différenciation. L’organisation qui triomphe en 2026 n’est plus celle qui déploie le plus de fonctionnalités le plus vite. C’est celle qui orchestre intelligemment ses agents IA, garantit l’intégrité de sa supply chain open source, optimise son empreinte carbone, offre une Developer Experience qui retient les talents, et maîtrise la dette de vérification que l’IA génère.

Recommandations actionnables pour 2026

- Mesurez votre « dette de vérification ». Avant d’accélérer la production de code IA, instrumentez votre pipeline pour suivre le ratio code généré / code reviewé. Si ce ratio dépasse 3:1, vous accumulez une dette invisible qui explosera en production. Notre guide sur la dette technique vous aide à structurer cette mesure.

- Auditez votre « Agent-Readiness ». Votre logiciel peut-il être opéré via des API par un agent autonome ? Si vos workflows critiques nécessitent une intervention manuelle dans une interface graphique, vous serez invisibles pour l’économie agentique. Exposez vos fonctionnalités clés via des endpoints bien documentés.

- Établissez votre base carbone logicielle. Intégrez la métrique SCI dans vos pipelines CI/CD dès maintenant. Quand le RGESN deviendra contraignant et que vos clients exigeront une « déclaration d’écoconception », vous aurez déjà les données pour prouver vos progrès.

- Investissez dans la « AI Fluency » de vos équipes. Ne formez pas seulement vos développeurs à utiliser Copilot — formez-les à le challenger. La compétence clé de 2026 n’est pas le prompt engineering, c’est la capacité à détecter quand l’IA se trompe et à comprendre pourquoi. Si vous avez besoin d’accompagnement, notre pôle IA est là pour ça.

- Anticipez le CRA avant septembre 2026. La date du 11 septembre 2026 arrive vite. Mettez en place la génération automatique de SBOM dans vos pipelines, cartographiez vos dépendances transitives et établissez un processus de signalement des vulnérabilités. Ne subissez pas la conformité — transformez-la en argument commercial.

- Créez votre Internal Developer Platform. Si vos développeurs passent plus de 20 % de leur temps sur des tâches d’infrastructure, c’est du temps volé à l’innovation. Commencez petit — un portail self-service pour le provisionnement — et itérez. L’investissement se rembourse en rétention des talents autant qu’en vélocité. Notre équipe de développement peut vous accompagner sur la mise en place.

Chez Polara Studio, c’est exactement la philosophie que nous appliquons au quotidien : construire des logiciels qui vont vite et qui tiennent dans le temps. Si vous cherchez un partenaire pour transformer ces tendances en avantage concret, parlons-en.

Analyse approfondie des tendances et insights de second ordre

Note de l’expert : cette section plonge dans les implications subtiles et les effets de ricochet des tendances analysées ci-dessus. Elle offre une vision granulaire pour les décideurs qui veulent voir au-delà des chiffres de surface.

Sur le Paradoxe du Code Rapide et l’émergence d’un « marché de la confiance »

Le paradoxe productivité/qualité que nous avons documenté en Partie 1 va engendrer un effet de second ordre majeur : l’émergence d’un marché de la confiance algorithmique. Si 96 % des développeurs ne font pas totalement confiance au code IA et que seuls 48 % vérifient systématiquement, la question qui se pose n’est pas « comment produire plus vite ? » — c’est « comment prouver que ça marche ? ».

Insight de second ordre : Nous allons voir apparaître des « labels de qualité du code IA », comparables aux certifications ISO pour les processus industriels. Les éditeurs de SaaS B2B qui pourront afficher un score de fiabilité audité de leur code (taux de couverture de tests, ratio code humain/IA, dette de vérification maîtrisée) auront un avantage commercial décisif. Le code ne sera plus seulement évalué sur ce qu’il fait, mais sur comment il a été produit et vérifié. C’est la naissance du « Software Provenance » comme argument de vente.

Sur la Bifurcation des Talents et la fin du « développeur full-stack »

La bifurcation juniors/seniors que nous avons décrite masque une mutation plus profonde : la mort annoncée du profil « full-stack généraliste ». Quand l’IA sait générer un CRUD complet en 30 secondes, la valeur du développeur qui savait « un peu de tout » s’effondre. Ce qui monte en flèche, c’est la valeur de l’hyperspécialiste — l’architecte sécurité, l’expert Kubernetes, l’ingénieur performance.

Insight de second ordre : Les « tiny teams » prédites par Gartner (80 % des organisations d’ici 2030) ne seront pas des équipes réduites par économie — ce seront des équipes d’élite composées de spécialistes, chacun augmenté par un essaim d’agents IA. Le modèle RH de l’industrie logicielle va basculer du « recruter beaucoup de généralistes » vers « retenir une poignée d’architectes irremplaçables ». Les salaires des profils seniors en IA, sécurité et architecture vont exploser — tandis que les profils juniors sans spécialisation distinctive verront leur marché se contracter. L’enjeu pour les entreprises : investir dans la montée en compétences de leurs juniors actuels avant qu’ils ne deviennent obsolètes.

Sur l’Infrastructure Invisible et le risque de « Platform Lock-in »

Le Platform Engineering promet de simplifier la vie des développeurs, mais il crée un effet de second ordre que peu d’organisations anticipent : le Platform Lock-in interne. Quand toute votre organisation dépend d’une Internal Developer Platform construite sur mesure, vous avez remplacé le vendor lock-in externe par une dépendance interne à l’équipe plateforme.

Insight de second ordre : Les organisations les plus matures vont créer un nouveau rôle : le « Platform Product Manager » — quelqu’un qui traite la plateforme interne comme un produit, avec des utilisateurs (les développeurs), des métriques de satisfaction, une roadmap et un budget. Les plateformes internes mal gérées deviendront le prochain grand générateur de dette technique — remplaçant les monolithes legacy d’aujourd’hui. Ironie : l’outil censé éliminer la complexité pourrait en devenir la source principale dans 5 ans.

Sur le Bouclier Réglementaire et l’avantage compétitif européen

La plupart des acteurs perçoivent NIS2, l’AI Act et le CRA comme des contraintes. C’est une lecture de surface. L’effet de second ordre est radicalement différent : la réglementation européenne est en train de créer un « moat » (fossé défensif) involontaire pour les éditeurs de logiciels européens.

Insight de second ordre : Les éditeurs qui auront investi tôt dans la conformité CRA, la génération automatique de SBOM et l’AI Act pourront exporter cette conformité comme argument commercial vers des marchés qui n’ont pas encore légiféré. Exactement comme le RGPD est devenu un standard mondial de facto, les entreprises européennes « compliance-native » auront un avantage de 2 à 3 ans sur leurs concurrents américains et asiatiques quand ces marchés adopteront des régulations similaires. Le coût de conformité d’aujourd’hui est l’avantage concurrentiel de demain. L’IRN (Indice de Résilience Numérique) lancé par Bercy pourrait même devenir un outil de notation des fournisseurs — un « Nutri-Score du logiciel » que les acheteurs exigeront dans leurs appels d’offres.

Sur le Code Responsable et le cercle vertueux FinOps-GreenOps-Performance

Nous avons décrit la convergence FinOps/GreenOps, mais l’insight de second ordre est plus puissant : il existe une corrélation directe entre durabilité, performance technique et performance commerciale.

Insight de second ordre : Un logiciel « green » est par définition un logiciel optimisé — moins de requêtes inutiles, des algorithmes plus efficaces, une infrastructure mieux dimensionnée. Dans un monde où le SEO est dominé par les Core Web Vitals et où le coût d’inférence IA peut tuer les marges SaaS, le Green Code deviendra le principal levier d’optimisation du taux de conversion ET des marges opérationnelles. Les entreprises ne feront pas du GreenOps pour la planète — elles le feront pour le profit, créant un cercle vertueux inattendu. L’éditeur SaaS qui consomme 30 % de compute en moins n’est pas seulement plus écologique : il est plus rentable, plus rapide, et mieux classé sur Google. C’est la convergence ultime — et c’est exactement ce que nous construisons chez Polara Studio.

Découvrez notre expertise en développement sur mesure

Articles similaires

SaaSpocalypse : faut-il encore lancer un SaaS en 2026 ?

SaaSpocalypse, 285 milliards effacés, IA qui remplace les apps : faut-il encore lancer un SaaS en 2026 ? La réponse contre-intuitive d'un CEO d'agence.

Lire

Piratage Vercel (Next.js) : la supply chain logicielle vacille à nouveau

Vercel (Next.js) confirme un piratage via un outil IA tiers. Après Axios, la supply chain logicielle inquiète. Décryptage des faits et des risques.

Lire

Impact de l'IA sur la productivité des développeurs en 2026

L'IA rend-elle vraiment les développeurs plus productifs ? 6 vérités contre-intuitives, chiffres à l'appui et retours des équipes qui la pratiquent.

Lire