Date de dernière mise à jour :

Sommaire

MCP (Model Context Protocol) : le standard qui connecte l’IA à vos outils en 2026

97 millions de téléchargements SDK par mois. Anthropic, OpenAI, Google, Microsoft — tous alignés derrière un même protocole. Et si le chaînon manquant entre vos outils métier et l’intelligence artificielle venait enfin d’être trouvé ? Bienvenue dans l’ère du Model Context Protocol, ou MCP pour les intimes.

Si vous développez un SaaS, si vous intégrez de l’IA dans vos produits, ou si vous vous demandez simplement pourquoi vos assistants IA ne savent toujours pas lire vos données CRM, cet article est fait pour vous. On décortique ensemble ce protocole qui est en train de redéfinir la manière dont l’IA interagit avec le monde réel.

L’IA a un problème d’intégration (et le MCP le résout)

Le constat : des LLMs puissants mais isolés

Les grands modèles de langage — LLMs — n’ont jamais été aussi performants. GPT-4, Claude, Gemini : ils raisonnent, codent, analysent. Mais demandez-leur d’aller chercher le dernier ticket Jira de votre équipe ou de créer un événement dans votre Google Calendar… et c’est le mur. Pourquoi ? Parce que chaque intégration nécessitait jusqu’ici un développement spécifique, une API custom, un connecteur ad hoc.

Résultat : une fragmentation massive. Chaque éditeur de SaaS, chaque outil d’IA, chaque développeur devait recréer ses propres ponts. Si vous aviez 5 outils à connecter à 3 modèles d’IA différents, il vous fallait potentiellement 15 intégrations distinctes. Un cauchemar de maintenance, et un frein réel à l’adoption de l’IA en entreprise.

Le MCP, c’est quoi exactement ?

Le Model Context Protocol (MCP) est un protocole open source créé par Anthropic fin 2024, conçu pour standardiser la manière dont les applications d’IA se connectent aux systèmes externes : bases de données, outils SaaS, fichiers locaux, API tierces…

L’analogie la plus parlante ? Pensez au USB-C. Avant l’USB-C, chaque appareil avait son propre connecteur : micro-USB pour le téléphone, Lightning pour la tablette, un troisième format pour l’appareil photo. Avec l’USB-C, un seul standard pour tous. Le MCP fait exactement la même chose pour l’IA : un protocole unique pour connecter n’importe quel modèle à n’importe quel outil.

Concrètement, au lieu de construire une intégration spécifique pour chaque paire modèle/outil, vous créez un serveur MCP une seule fois — et tous les clients compatibles (Claude, ChatGPT, VS Code, Cursor…) peuvent s’y connecter instantanément. Fini le travail en double, en triple, en quadruple. Un effort d’intégration unique, une compatibilité universelle.

Comment fonctionne le MCP : l’architecture en 3 minutes

Client, serveur, host : les rôles clés

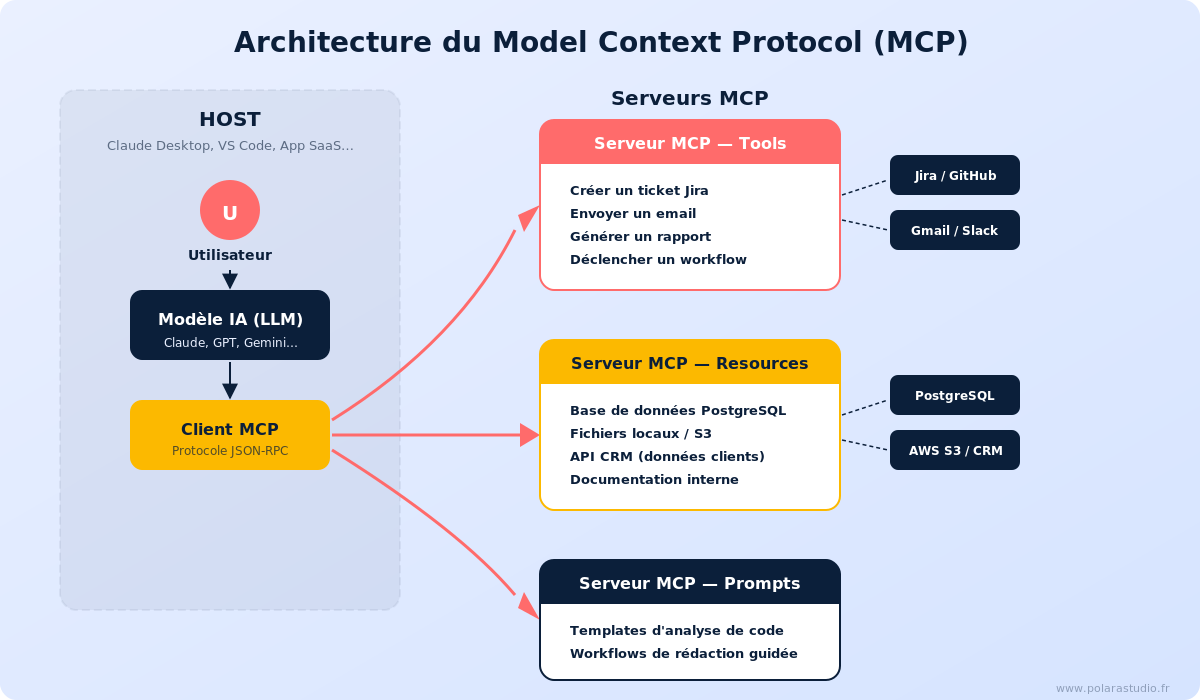

L’architecture MCP repose sur trois acteurs fondamentaux :

| Composant | Rôle | Exemple concret |

|---|---|---|

| Host | L’application qui héberge le client MCP et gère l’interaction utilisateur | Claude Desktop, VS Code, une app SaaS avec IA intégrée |

| Client | Le composant qui maintient la connexion avec un serveur MCP (1 client = 1 serveur) | Le module MCP intégré dans votre application |

| Serveur | Expose des capacités (outils, ressources, prompts) au client via le protocole standardisé | Un serveur MCP pour Google Calendar, Jira, votre base PostgreSQL… |

Le flux est simple : l’utilisateur interagit avec le host, qui pilote un client MCP, lequel communique avec un ou plusieurs serveurs MCP pour accéder aux données et exécuter des actions. Le tout via un protocole JSON-RPC standardisé.

Tools, Resources, Prompts : les 3 primitives du protocole

Le MCP expose trois types de capacités, qu’on appelle primitives :

| Primitive | Description | Exemple |

|---|---|---|

| Tools | Des actions que le modèle peut déclencher (similaire aux API classiques) | Créer un ticket Jira, envoyer un email, générer un rapport |

| Resources | Des données contextuelles que le modèle peut consulter | Lire un fichier, accéder à une base de données, récupérer un document |

| Prompts | Des templates de prompts prédéfinis pour guider le modèle dans des workflows spécifiques | Un prompt optimisé pour l’analyse de code, la rédaction d’emails, etc. |

C’est cette combinaison qui rend le MCP si puissant : un serveur peut à la fois fournir des données de contexte (Resources), offrir des actions concrètes (Tools), et proposer des workflows guidés (Prompts). Le tout accessible de manière uniforme par n’importe quel client compatible.

Pourquoi tout le monde adopte le MCP en 2026

D’Anthropic à OpenAI, Google et Microsoft : un consensus rare

Dans l’univers tech, voir des concurrents directs s’aligner derrière un même standard est suffisamment rare pour être souligné. Pourtant, c’est exactement ce qui s’est passé avec le MCP. Lancé par Anthropic en novembre 2024, le protocole a été adopté en quelques mois par les plus grands acteurs du secteur :

- OpenAI a intégré le support MCP dans ChatGPT et son Agents SDK

- Google l’a adopté pour ses services IA

- Microsoft l’a intégré dans VS Code et Copilot

- Des dizaines d’outils de développement — Cursor, Replit, Sourcegraph — l’ont implémenté

Le protocole est désormais hébergé sous la Linux Foundation, garantissant une gouvernance ouverte et neutre. Ce n’est plus le projet d’une seule entreprise — c’est un standard industriel.

Les chiffres clés de l’adoption

| Indicateur | Chiffre |

|---|---|

| Téléchargements SDK mensuels | 97M+ |

| Lancement du protocole | Novembre 2024 |

| Soutien des majors | Anthropic, OpenAI, Google, Microsoft, AWS |

| SDKs officiels disponibles | TypeScript, Python, C#, Java |

| Clients compatibles | Claude, ChatGPT, VS Code, Cursor, Replit… |

| Gouvernance | Linux Foundation |

Ces chiffres parlent d’eux-mêmes. En à peine plus d’un an, le MCP est passé d’un projet expérimental à un standard incontournable. Pour les éditeurs SaaS, ignorer ce mouvement revient à ignorer les API REST dans les années 2010 — techniquement possible, mais stratégiquement risqué.

Cas d’usage concrets pour les éditeurs SaaS

Connecter un SaaS métier à un assistant IA

Imaginons que vous éditez un SaaS de gestion de projet. Avant le MCP, pour permettre à Claude ou ChatGPT d’interagir avec votre outil, il fallait développer un plugin spécifique pour chaque plateforme d’IA. Avec le MCP, vous développez un seul serveur MCP qui expose vos fonctionnalités (créer un ticket, assigner une tâche, consulter un sprint…) — et tous les clients compatibles y accèdent automatiquement.

Résultat : vos utilisateurs peuvent demander à leur assistant IA « Montre-moi les tickets critiques du sprint en cours » ou « Crée une tâche pour corriger le bug de la page d’accueil et assigne-la à Marie », directement depuis leur outil d’IA préféré. L’intégration est transparente, et votre SaaS gagne en valeur perçue.

C’est aussi un argument commercial de poids : dans un marché SaaS B2B de plus en plus concurrentiel, proposer un serveur MCP à vos clients, c’est leur dire « notre outil s’intègre nativement avec votre assistant IA, quel qu’il soit ». Un vrai différenciateur face aux concurrents qui en sont encore aux intégrations manuelles.

Orchestration multi-agents via MCP

2026 marque l’essor des systèmes multi-agents. Selon Gartner, 40 % des applications d’entreprise intégreront des agents IA spécialisés d’ici fin 2026, contre moins de 5 % en 2025. Le MCP joue un rôle central dans cette évolution : il fournit le protocole de communication entre agents spécialisés, un enjeu clé du développement d’IA agentique.

Concrètement, un agent « support client » peut interroger un serveur MCP connecté à votre CRM, pendant qu’un agent « facturation » accède à votre système comptable via un autre serveur MCP. Le tout orchestré de manière fluide, sans intégration propriétaire. Si le sujet des agents IA vous intéresse, notre guide complet pour créer son agent IA en 2026 détaille les étapes clés.

Exemples réels d’intégrations

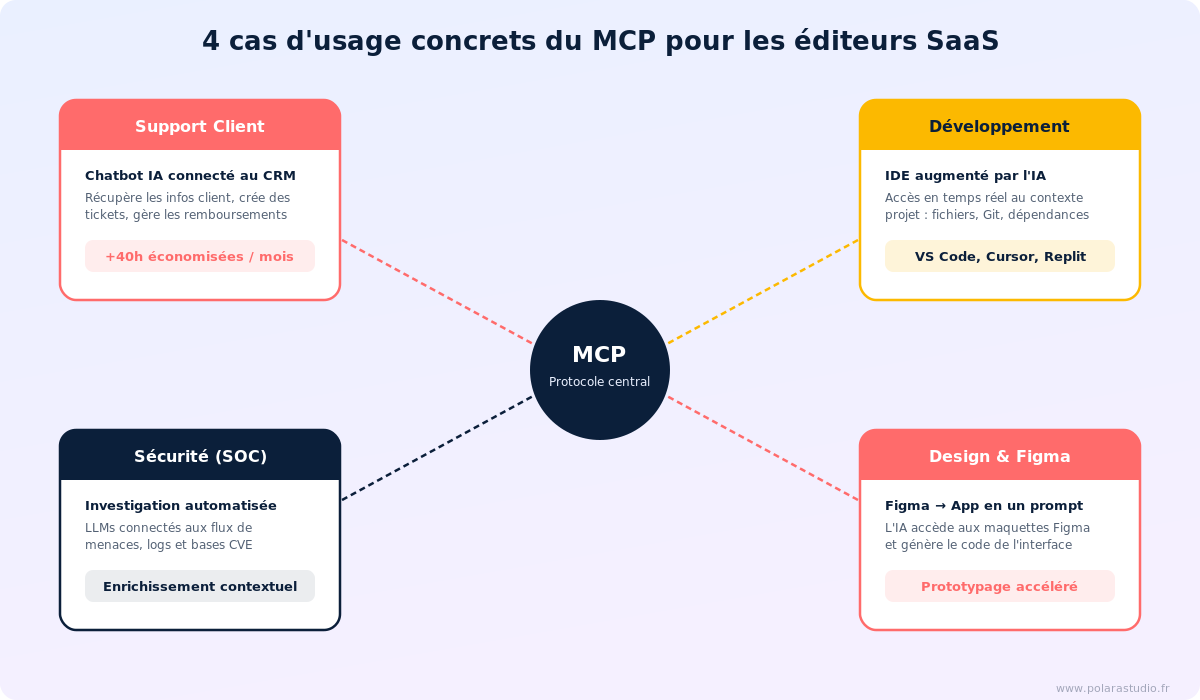

Le MCP n’est pas un concept théorique — il est déjà en production dans de nombreux contextes :

- Support client : un chatbot d’entreprise utilise un serveur MCP pour récupérer les infos client depuis le CRM et en créer un ticket dans Jira, le tout dans une seule conversation. Des équipes rapportent un gain de plus de 40 heures par mois sur les tâches de support.

- Développement logiciel : des IDE comme VS Code et Cursor utilisent le MCP pour donner à leurs assistants IA un accès en temps réel au contexte du projet — fichiers, dépendances, historique Git.

- Sécurité : les équipes SOC connectent leurs LLMs à plusieurs flux de menaces, logs internes et bases de vulnérabilités via des serveurs MCP, accélérant l’investigation des incidents.

- Design : Claude Code peut générer une application web complète à partir d’un design Figma, grâce à un serveur MCP qui expose le contenu des maquettes.

Pour aller plus loin sur l’intégration de l’IA dans un produit SaaS, cet article recense 10 cas d’usage rentables.

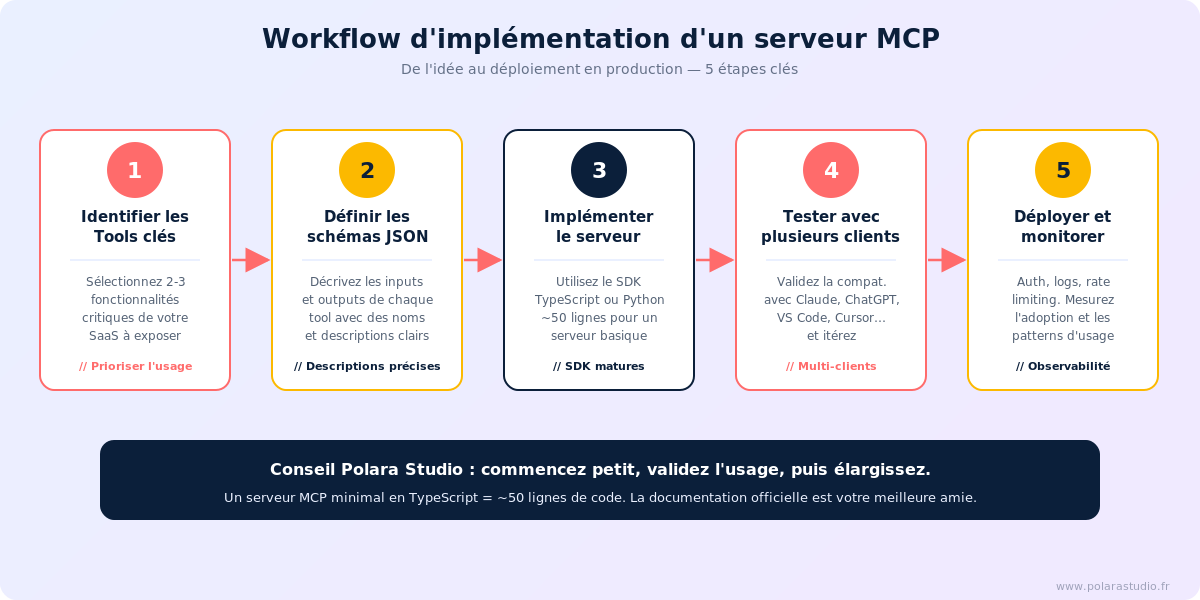

Comment implémenter le MCP dans votre produit

Les SDK disponibles et par où commencer

La bonne nouvelle, c’est que l’écosystème MCP est déjà très mature côté outillage. Quatre SDK officiels sont disponibles :

- TypeScript (GitHub) : tourne sur Node.js, Bun et Deno. Le plus populaire et le plus documenté.

- Python (GitHub) : idéal si votre stack backend est en Python ou pour des projets data/ML.

- C# et Java : pour les environnements enterprise .NET et JVM.

Pour démarrer, le chemin le plus court consiste à créer un serveur MCP minimal qui expose un ou deux tools de votre application. Un serveur MCP basique en TypeScript, c’est une cinquantaine de lignes de code : vous déclarez vos outils avec leur schéma JSON d’entrée/sortie, et vous implémentez le handler pour chaque appel. La documentation officielle est excellente et propose des guides pas à pas.

Le transport par défaut utilise le protocole HTTP Streamable, qui permet une communication bidirectionnelle entre client et serveur. Pour le développement local et le prototypage, le transport stdio (entrée/sortie standard) est également supporté — ce qui permet de tester votre serveur directement depuis un terminal sans même déployer de serveur HTTP. Un vrai gain de temps en phase de développement.

Bonnes pratiques et pièges à éviter

Après avoir accompagné plusieurs projets d’intégration IA chez Polara Studio, voici les points de vigilance que nous recommandons :

- Commencez petit : exposez 2-3 outils critiques plutôt que toute votre API. Validez l’usage avant d’élargir.

- Soignez les descriptions : le modèle d’IA choisit quel outil utiliser en se basant sur les descriptions que vous fournissez. Des descriptions floues = des appels erronés.

- Gérez les permissions : le MCP ne remplace pas votre couche d’authentification. Assurez-vous que chaque appel est authentifié et autorisé, comme vous le feriez pour n’importe quelle API.

- Pensez observabilité : loggez les appels MCP dès le départ. Quand un agent IA fait une action dans votre système, vous devez pouvoir tracer qui, quoi, quand.

- Testez avec plusieurs clients : un serveur MCP fonctionnel avec Claude peut avoir des comportements différents avec ChatGPT ou Cursor. Testez la compatibilité.

Et si vous vous lancez dans la création d’un agent IA sur mesure, attention aux erreurs classiques — on les a recensées pour vous.

Ce que la roadmap 2026 du MCP nous réserve

Scalabilité, auth enterprise et multi-agents

La roadmap officielle 2026 du MCP se structure autour de quatre axes majeurs :

- Scalabilité des transports : le protocole HTTP Streamable évolue pour permettre aux serveurs MCP de fonctionner sans état (stateless) sur plusieurs instances, avec une gestion de sessions qui permet la création, la reprise et la migration transparente des sessions. Un système de Server Cards (métadonnées au format

.well-known) facilitera la découverte automatique des serveurs. - Communication entre agents : la fonctionnalité Tasks sort de sa phase expérimentale, avec des mécanismes de retry en cas d’échec transitoire et des politiques d’expiration des résultats.

- Enterprise readiness : audit trails, authentification SSO, gestion des passerelles et portabilité de la configuration — tout ce dont les DSI ont besoin pour déployer le MCP à l’échelle.

- Gouvernance : un modèle de Contributor Ladder et de délégation aux Working Groups, reflétant la maturité croissante du projet.

Vers un écosystème de serveurs MCP standardisés

La tendance de fond, c’est la commoditisation des connecteurs IA. Tout comme il existe aujourd’hui des milliers de packages npm ou de bibliothèques pip, on voit émerger un écosystème de serveurs MCP prêts à l’emploi. Des registres centralisés permettent déjà de découvrir et installer des serveurs MCP pour les outils les plus courants — Slack, GitHub, Google Workspace, bases de données SQL…

En 2026, le MCP commence aussi à supporter les contenus multimodaux : images, vidéo, audio. Les agents ne se contentent plus de lire et écrire du texte — ils peuvent prendre une capture d’écran, la décrire, et agir en conséquence. Cette évolution ouvre des cas d’usage encore inexplorés, notamment dans le design, le contrôle qualité visuel ou la supervision industrielle.

Un autre signal fort : l’émergence de registres de serveurs MCP, similaires à ce que npm est pour JavaScript ou PyPI pour Python. Ces registres permettent aux développeurs de publier, découvrir et installer des serveurs MCP en quelques commandes. Vous cherchez un connecteur pour Salesforce, HubSpot ou Stripe ? Il y a probablement déjà un serveur MCP communautaire disponible. Cette dynamique d’écosystème accélère considérablement l’adoption et réduit le coût d’entrée pour les éditeurs.

Pour les éditeurs SaaS, le message est clair : proposer un serveur MCP pour votre produit n’est plus un « nice to have » — c’est un avantage concurrentiel. Vos utilisateurs attendent de pouvoir connecter vos outils à leur assistant IA préféré, et le MCP est le pont standardisé pour y parvenir.

Le MCP, un investissement stratégique pour votre SaaS

Le Model Context Protocol n’est pas une énième hype technologique. C’est un standard en train de s’imposer, soutenu par les plus grands acteurs de l’IA, avec une adoption qui explose et une roadmap solide. Pour les éditeurs de SaaS et les entreprises qui intègrent de l’IA dans leurs produits, le MCP représente une opportunité stratégique de se positionner tôt sur un standard qui sera bientôt incontournable — et de ne pas revivre le syndrome du « on verra plus tard » qui a coûté cher à beaucoup d’entreprises à l’époque des API REST ou du mobile-first.

Le chemin le plus pragmatique ? Commencez par un serveur MCP minimal qui expose vos fonctionnalités clés, validez l’usage avec vos utilisateurs early adopters, mesurez l’adoption, puis élargissez progressivement. Les SDK sont matures, la documentation est solide, la communauté est active, et les retours terrain montrent que le ROI est rapide — souvent dès les premières semaines d’usage.

Chez Polara Studio, on accompagne déjà nos clients dans l’intégration du MCP au sein de leurs produits SaaS — de la conception de l’architecture à la mise en production. Si vous envisagez de connecter votre logiciel à l’écosystème IA, parlons-en.

Découvrez comment nous intégrons l'IA dans vos produits

Articles similaires

Piratage Vercel (Next.js) : la supply chain logicielle vacille à nouveau

Vercel (Next.js) confirme un piratage via un outil IA tiers. Après Axios, la supply chain logicielle inquiète. Décryptage des faits et des risques.

Lire

Impact de l'IA sur la productivité des développeurs en 2026

L'IA rend-elle vraiment les développeurs plus productifs ? 6 vérités contre-intuitives, chiffres à l'appui et retours des équipes qui la pratiquent.

Lire

Tendances et statistiques majeures du développement logiciel en 2026

Développement logiciel 2026 : statistiques, tendances IA, régulations européennes et pénurie de talents. L'analyse complète des 5 méga-forces de l'année.

Lire